인트로덕션

최근 AI 기술의 발전은 고객 서비스 분야에 큰 변화를 가져왔습니다. 특히 대화형 AI 에이전트를 활용하여 자연스러운 고객 경험을 제공하고 효율적인 비즈니스 프로세스를 구축하는 것이 중요해지고 있습니다. 이번 포스트에서는 Amazon Bedrock, LangGraph, 그리고 Amazon SageMaker AI에서 관리되는 MLflow를 사용하여 지능형 대화형 에이전트를 구축하는 방법을 살펴봅니다.

본문

해결책 개요

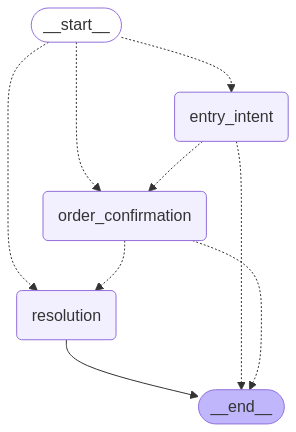

이번에 소개할 대화형 AI 에이전트는 고객의 주문 문의와 같은 일반적인 고객 서비스 자동화 솔루션의 문제점을 해결하기 위해 설계되었습니다. 이 에이전트는 고객이 주문 정보를 찾고 취소와 같은 작업을 자연스러운 대화를 통해 처리할 수 있도록 돕습니다. 시스템은 그래프 기반 대화 흐름을 사용하며 세 가지 주요 단계를 통해 작동합니다.

- 입력 의도 단계: 고객의 요구를 파악하고 필요한 정보를 수집합니다.

- 주문 확인 단계: 찾은 주문 세부 정보를 제공하고 고객의 의도를 확인합니다.

- 해결 단계: 고객의 요청을 실행하고 마무리 정보를 제공합니다.

이 과정은 아래의 워크플로우 차트에서 시각화할 수 있습니다.

주요 문제점

대부분의 고객 서비스 자동화 솔루션은 규칙 기반과 LLM 기반으로 나뉘는데, 각 방식 모두 한계가 존재합니다. 규칙 기반 시스템은 자연어 이해에서 어려움을 겪으며, LLM 기반 시스템은 멀티스텝 프로세스를 관리하기 어렵습니다.

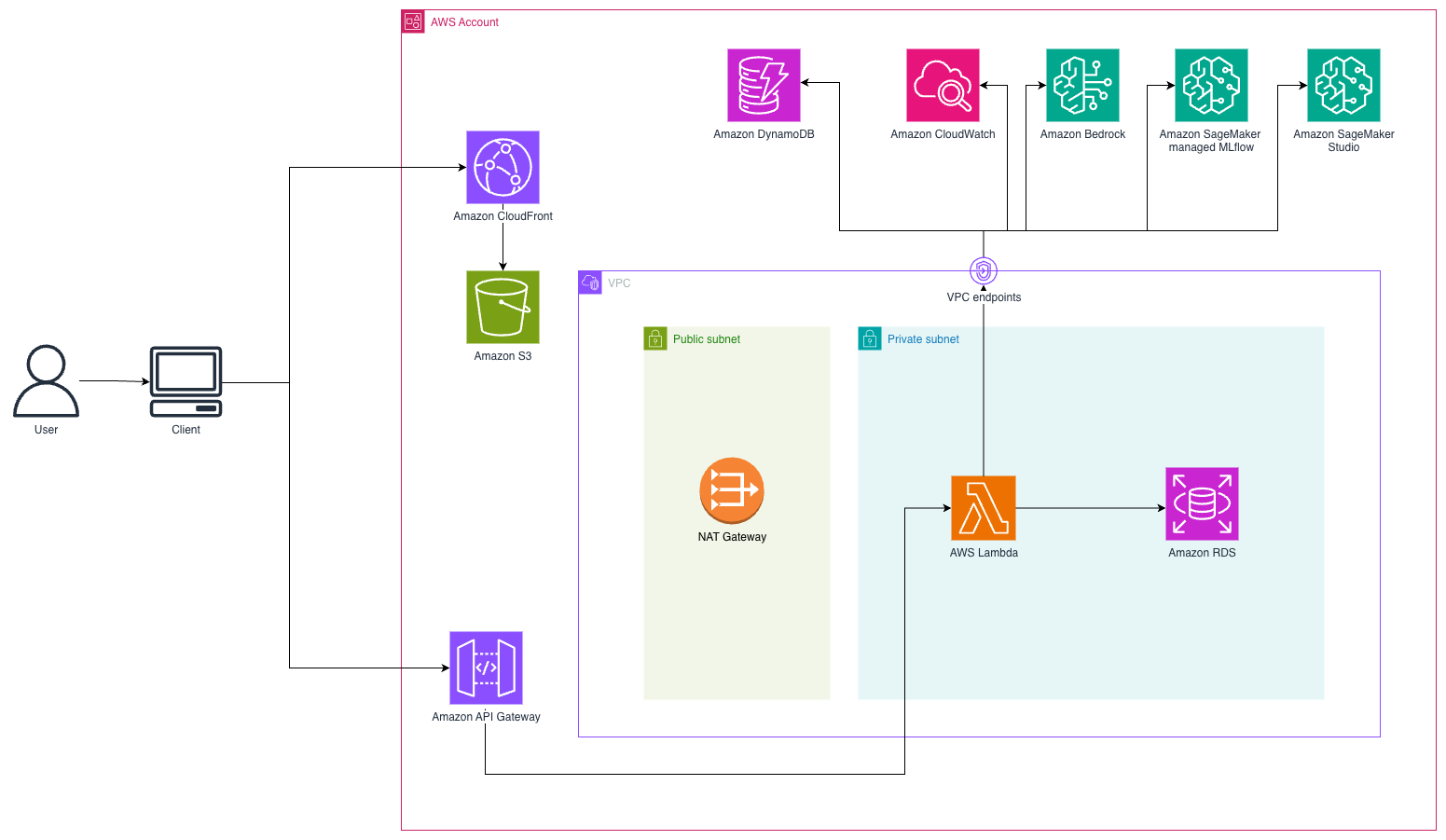

솔루션 아키텍처

이 솔루션은 Amazon S3에서 호스팅되는 React 프론트엔드에서 시작되며, Amazon API Gateway를 통한 WebSocket 연결을 이용하여 실시간 고객 상호작용을 지원합니다. 백엔드에서는 AWS Lambda가 대화 흐름을 관장합니다.

에이전트 아키텍처

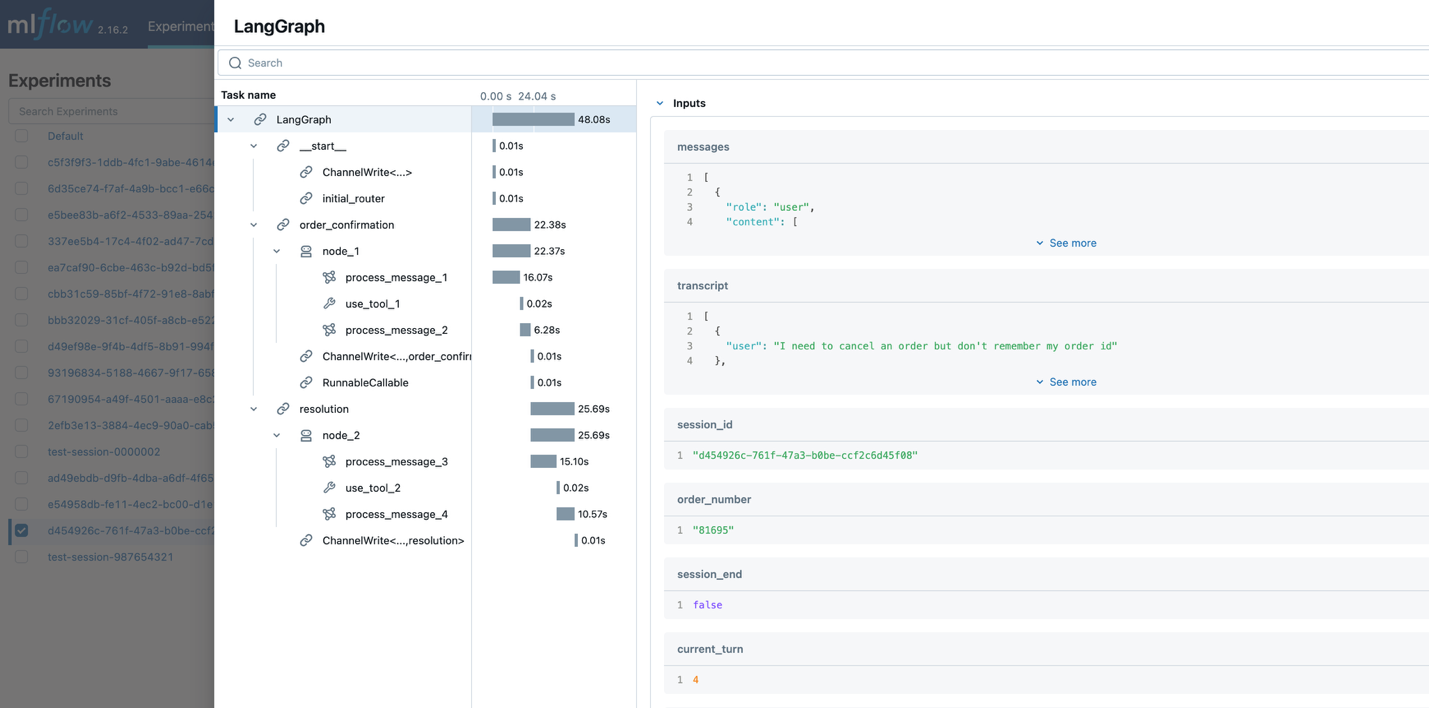

이 솔루션은 LLM의 자연어 능력과 구조적인 워크플로우를 결합하여, 상태 유지 및 외부 도구와의 연동을 통해 다양한 작업을 수행할 수 있는 AI 에이전트를 구현합니다. LangGraph를 통한 오케스트레이션은 여러 단계의 워크플로우를 효율적으로 관리합니다.

MLflow는 대화 흐름 모니터링과 모델 성능 최적화를 위해 활용되며, 다음과 같은 방식을 제공합니다:

배포 가이드

서버리스 대화형 AI 에이전트를 구축하려면, 아래 단계를 따라야 합니다:

- 리포지토리 클론 및 프로젝트 설정

- AWS 환경 부트스트랩

- 의존성 설치

- 애플리케이션 배포

이 스크립트는 백엔드 인프라를 배포하고, 프론트엔드와 통합된 WebSocket API Gateway를 설정하며, Amazon S3에 런타임 구성을 업로드합니다.

결론

본 포스트에서는 LLM, LangGraph, Amazon SageMaker AI의 MLflow가 결합된 대화형 AI 에이전트를 구축하는 방법을 소개했습니다. 이러한 아키텍처는 자연스럽고 다단계의 대화를 유도하며, 실시간으로 고객의 요구를 효율적으로 해결합니다. AWS의 서버리스 서비스를 이용하여, 이 솔루션은 다양한 워크로드를 자동으로 확장하며 비용 효율성을 유지합니다.

AI, Cloud 관련한 문의는 아래 연락처로 연락주세요!

(주)에이클라우드

이메일 : acloud@a-cloud.co.kr

회사 번호 : 02-538-3988

회사 홈페이지 : https://www.a-cloud.co.kr/

문의하기