서론

아마존 SageMaker AI의 서버리스 모델 커스터마이제이션을 사용하면 인프라를 관리하지 않고도 AI 모델의 성능을 향상시킬 수 있습니다. 이번 글에서는 RLVR(Verifiable Rewards 기반 강화학습)을 활용한 아마존 SageMaker AI 모델 커스터마이제이션의 활용 방법을 살펴봅니다.

본문

서버리스 모델 커스터마이제이션의 장점

기존의 AI 에이전트들은 도구 호출 시 많은 문제를 겪어왔습니다. 서버리스 모델 커스터마이제이션은 이러한 문제를 해결하기 위해 Reinforcement Learning with Verifiable Rewards(RLVR)을 활용합니다. RLVR은 모델이 자체적으로 후보 응답을 생성하고, 보상 신호를 받아 품질을 평가한 뒤 행동을 개선하는 방식으로 동작합니다.

AWS SageMaker에서의 RLVR 적용 사례

AWS SageMaker AI의 RLVR을 활용하여 Qwen 2.5 7B Instruct 모델을 미세 조정한 사례를 예로 들어보겠습니다. 이 과정은 데이터셋 준비, 보상 함수 설계, 훈련 구성 및 해석, 그리고 배포로 이어집니다. 훈련된 모델은 훈련 중에 보지 못했던 시나리오들에 대해 57% 가량의 향상된 도구 호출 보상을 보여주었습니다.

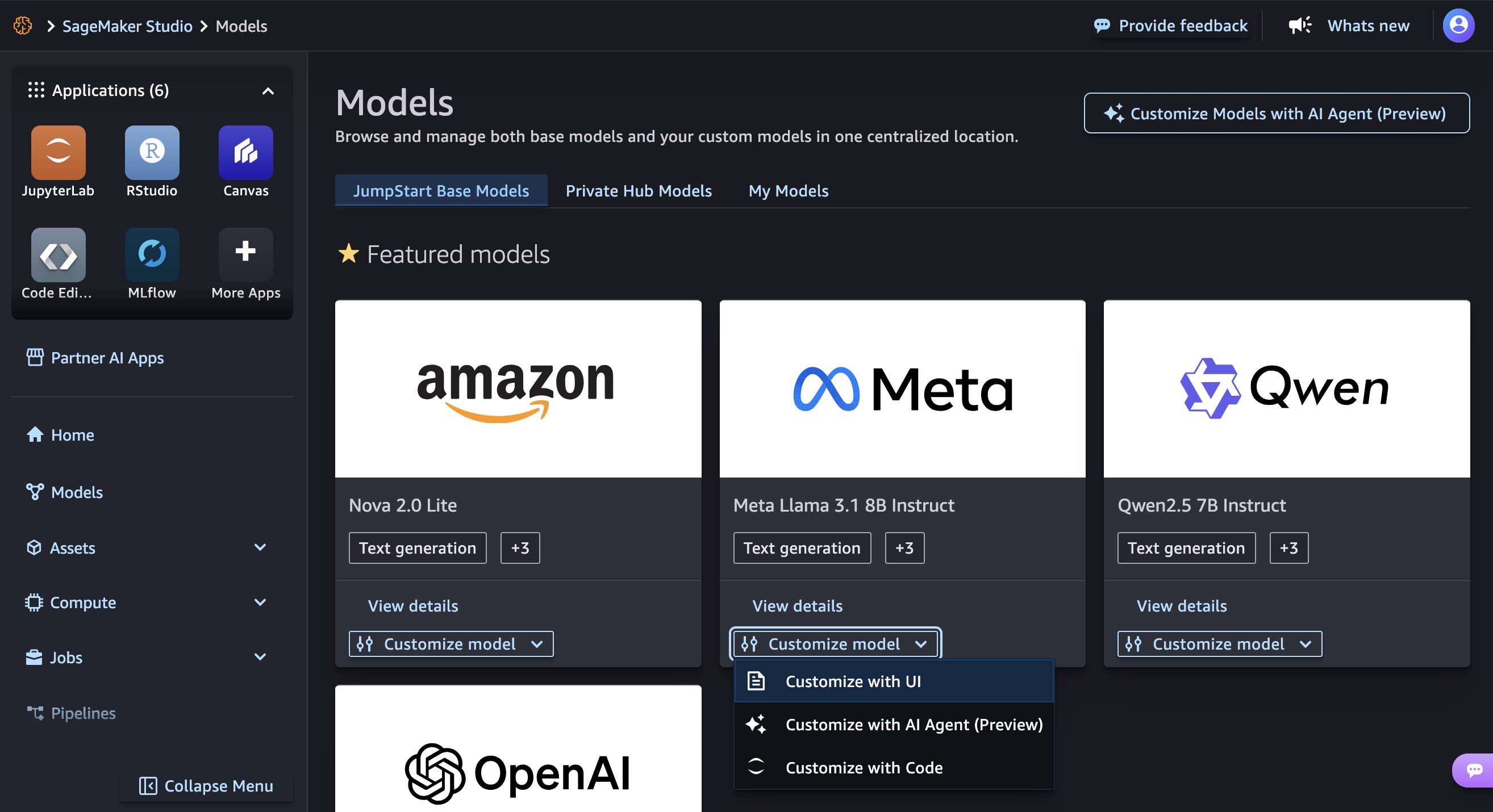

위 이미지는 Amazon SageMaker의 모델 커스터마이제이션 UI를 보여주며, 다양한 커스터마이제이션 기법 선택 옵션을 제공합니다.

데이터 준비와 보상 함수 설계

도구 호출 데이터셋은 올바른 API 호출 이상을 가르칩니다. 훈련 예제에는 다양한 사용자의 요청과 이에 따른 모델의 적합한 응답이 포함됩니다. 또한, 보상 함수는 훈련 데이터의 실제 값과 모델의 응답을 비교하여 평가 점수를 반환하는 Python 함수로 작성됩니다.

모델 배포

훈련이 완료된 후, Amazon SageMaker AI 또는 Amazon Bedrock을 통해 모델을 배포할 수 있습니다. 직접 다운로드하여 자체적으로 배포할 수도 있습니다.

결론

SageMaker AI의 RLVR을 통해 Qwen 2.5 7B 모델을 개선한 결과, 도구 호출의 정확도가 크게 향상되었습니다. 추가적인 훈련 데이터와 보상 함수 조정을 통해 보다 다양한 시나리오에 대처할 수 있도록 개선할 수 있습니다. 개발팀의 로그를 활용한다면 더욱 높은 성능의 훈련 데이터를 얻을 수 있습니다.

AI, Cloud 관련한 문의는 아래 연락처로 연락주세요!

(주)에이클라우드

이메일 : acloud@a-cloud.co.kr

회사 번호 : 02-538-3988

회사 홈페이지 : https://www.a-cloud.co.kr/

문의하기