P-EAGLE: vLLM의 병렬 추론 가속화를 위한 혁신적 접근

최근 AI 분야에서는 추론 속도를 높이기 위해 다양한 기법들이 사용되고 있습니다. 그중에서도 P-EAGLE는 기존의 EAGLE 방식보다 더 빠른 LLM(대규모 언어 모델) 추론을 가능하게 하며, 병렬 예측 기법을 도입함으로써 높은 성능을 보여주고 있습니다. 이 글에서는 P-EAGLE의 작동 방식, vLLM에의 통합 과정 및 실제 구현 사례에 대해 알아보겠습니다.

P-EAGLE란 무엇인가?

P-EAGLE는 EAGLE의 병목 현상을 없애고, 전체 드래프트 토큰을 한 번의 전방 전달로 생성하는 혁신적인 방법입니다. 이를 통해 NVIDIA B200 환경에서, EAGLE-3를 사용한 기존 방법에 비해 최대 1.69배의 속도 향상을 이루었습니다. P-EAGLE의 이러한 효율성은 자동화된 배포 가이드를 통해 손쉽게 활용할 수 있으며, HuggingFace에서 미리 훈련된 모델로도 손쉽게 시작할 수 있습니다.

시스템 아키텍처와 활용 사례

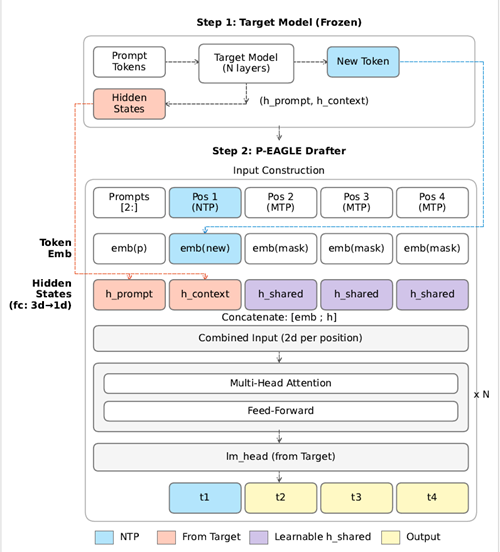

P-EAGLE의 아키텍처는 주로 두 가지 단계로 구성됩니다. 첫째, 대상 모델이 프롬프트를 처리하고 새로운 토큰을 생성하는 사전 채우기 단계가 있습니다. 둘째, 병렬 드래프트 생성 단계입니다. 이 과정에서 각 포지션은 병렬로 처리되어 전체 드래프트 토큰을 예측하는 데 소요되는 시간을 줄여줍니다.

vLLM 플랫폼에 통합된 P-EAGLE는 병렬 사양 예측을 통해 실시간 배포 환경에서 더욱 빠른 모델 추론을 제공합니다. 예를 들어, GPT-OSS-20B 모델에 적용시켰을 때, 병렬 드래프팅 설정을 통해 대규모 데이터셋에서도 그 성능을 입증했습니다.

실제 적용 및 성능 비교

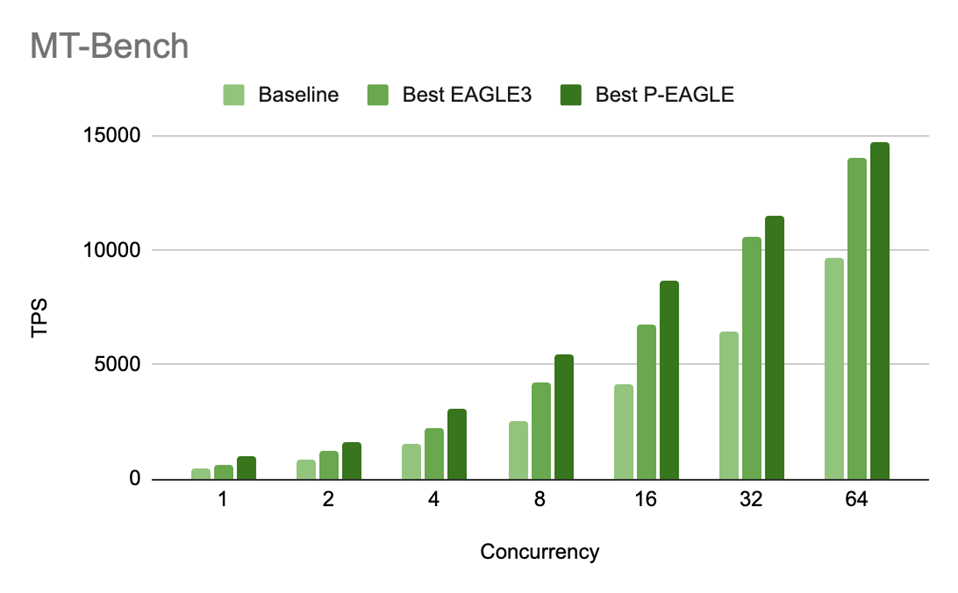

P-EAGLE는 GT-OSS-20B에 대해 다양한 벤치마크 테스트를 통해 그 우수성을 입증했습니다. 실제로 MT-Bench, HumanEval 등에서 EAGLE-3에 비해 55-69%의 고속 처리량을 기록하였으며, 병렬 드래프팅을 통해 사양 깊이 K에 따른 TPS(초당 토큰 수) 최적화를 이끌어냈습니다.

결론적으로, P-EAGLE은 대규모 언어 모델에서의 병렬 예측 구현을 통해 추론 성능을 혁신적으로 향상시킵니다. 이를 통해 P-EAGLE은 미래의 LLM 배포에 있어 필수적인 요소로 부각되고 있으며, 성능 최적화와 지연 시간 감소에 크게 기여할 것입니다.

P-EAGLE의 성능을 직접 확인해보세요: HuggingFace에서 미리 훈련된 P-EAGLE 헤드를 다운로드하고, vLLM 구성에 "parallel_drafting": true 설정을 적용하여 바로 시작할 수 있습니다.

AI, Cloud 관련한 문의는 아래 연락처로 연락주세요!

(주)에이클라우드

이메일 : acloud@a-cloud.co.kr

회사 번호 : 02-538-3988

회사 홈페이지 : https://www.a-cloud.co.kr/

문의하기