기업용 생성형 AI 어시스턴트 구축을 위한 고도화된 RAG 방식: Amazon Bedrock 사례

기업에서는 점차 생성형 AI 기반 어시스턴트를 활용하여 고객 응대, 내부 문서 검색, 실시간 인사이트 발굴 등 다양한 업무를 자동화하고 있습니다. 그러나 불완전한 정보 기반의 응답이나 '환각(hallucination)' 문제가 여전히 발생하고 있으며, 이러한 정확성 한계를 극복하기 위한 방법 중 하나가 바로 RAG(Retrieval-Augmented Generation)입니다. 본 블로그에서는 Amazon Bedrock와 고급 RAG 기법을 활용하여 AI 어시스턴트 정확도를 획기적으로 향상시킨 Nippon India Mutual Fund의 사례를 통해 실무적인 적용 방법과 구성요소를 알아봅니다.

RAG 기본 구성과 Amazon Bedrock의 활용

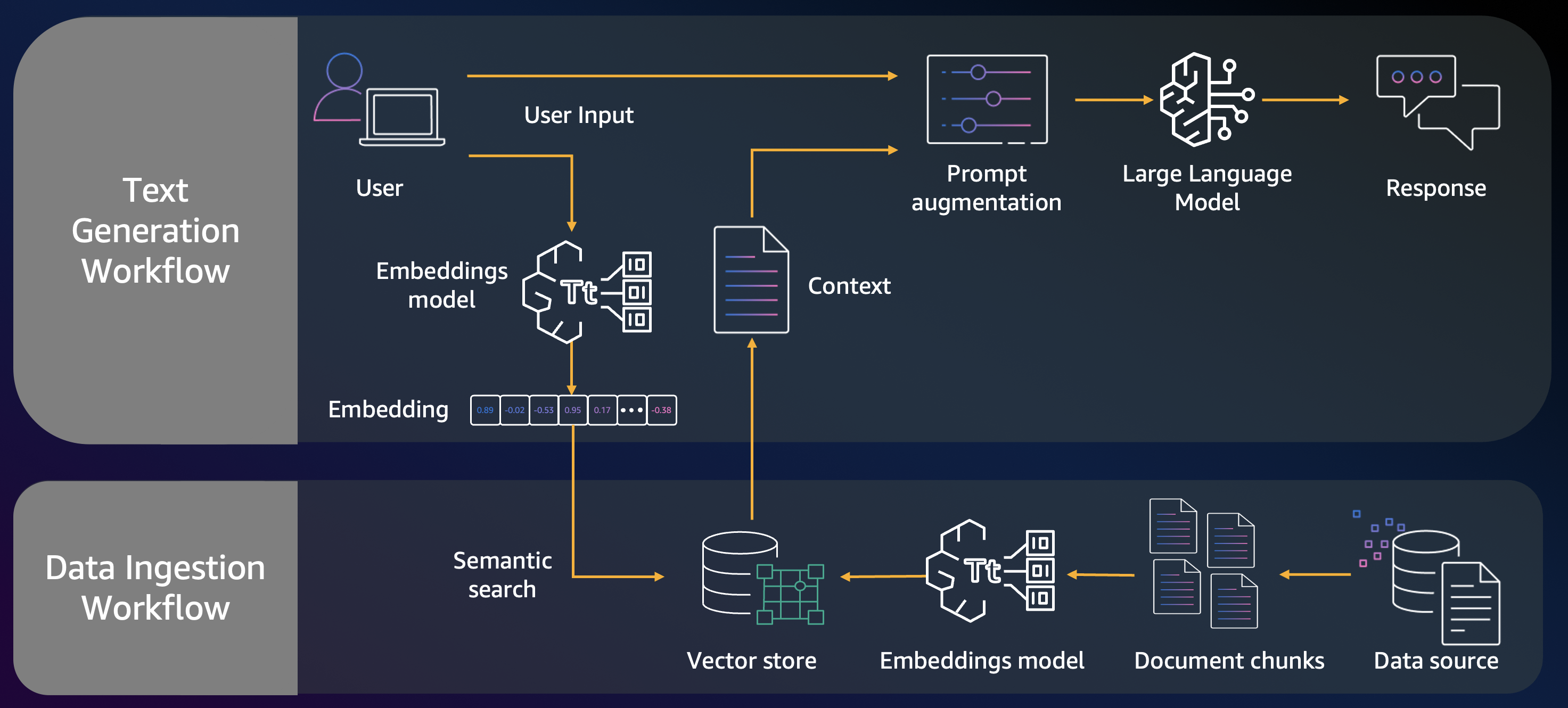

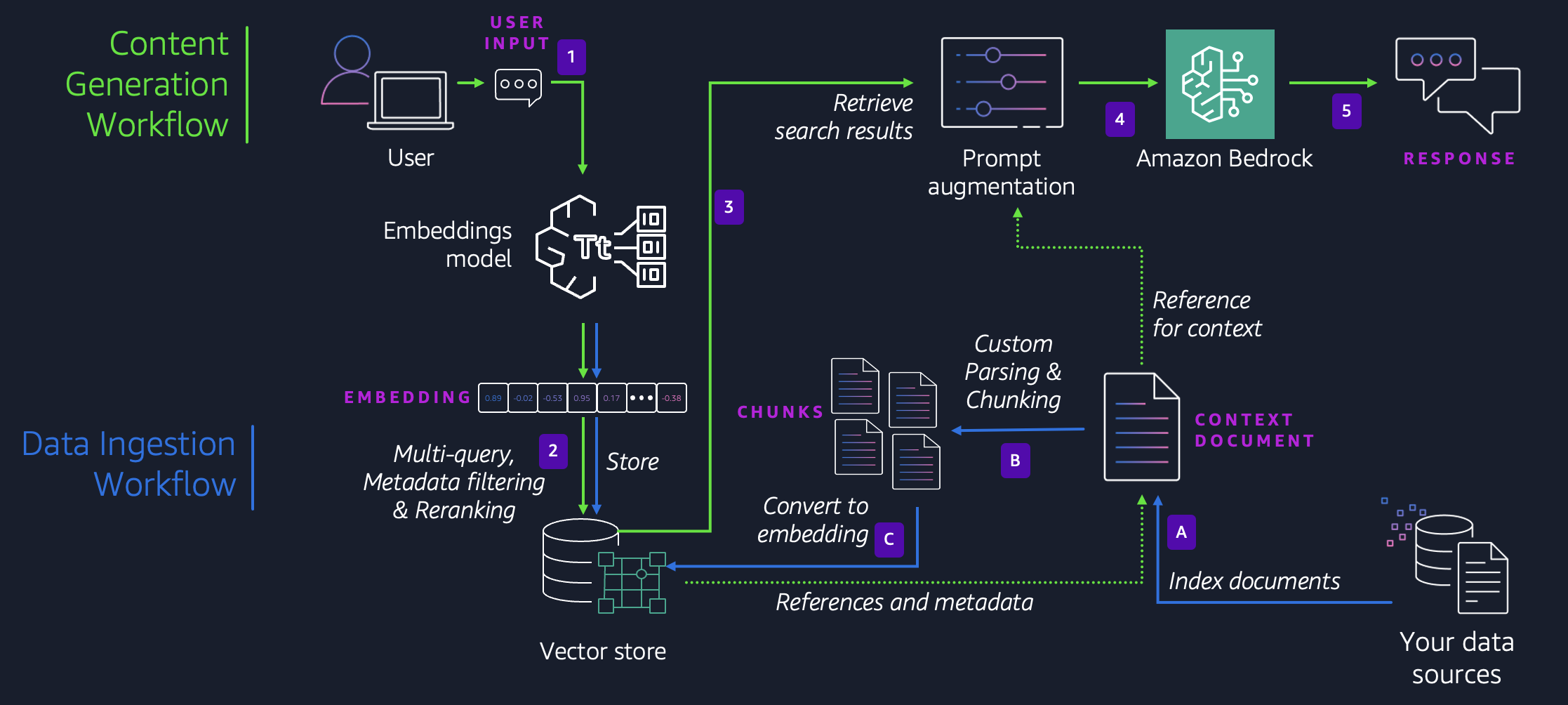

기본적인 RAG 방식은 다음과 같은 두 단계로 구성됩니다:

- 데이터 수집 및 처리(ingestion): 관련 문서를 일정 단위(chunk)로 나누고 임베딩(embedding)을 생성하여 벡터 데이터베이스에 저장.

- 텍스트 생성: 사용자 질의를 임베딩한 후, 벡터 데이터베이스에서 유사한 콘텐츠를 검색하여 생성형 AI 모델에게 컨텍스트로 전달하고 응답 생성.

Amazon Bedrock Knowledge Bases는 이러한 RAG 구현을 완전관리형 형태로 제공하여, 데이터 연결, 청킹, 임베딩 생성, 질의 매칭까지 자동화합니다. AI21 Labs, Anthropic, Meta 등 다양한 고성능 모델을 단일 API로 사용할 수 있으며, 강화된 보안, 개인정보 보호, 책임감 있는 AI 기능도 제공합니다.

고도화된 RAG 기법으로 정확도 향상

Nippon은 수천 개 문서에 대한 검색 정확도를 높이기 위해 고도화된 RAG 방식을 도입했습니다. 기존 RAG 방식에서는 상위 5~10개의 문서만을 기반으로 응답을 생성하는데, 이는 유사성 일치 기반 매칭으로 인해 가장 관련성 높은 정보가 누락될 가능성이 있다는 제약이 있습니다. 이에 Nippon은 다음과 같은 방법으로 해결책을 마련했습니다.

- Amazon Textract를 이용한 구조화 데이터 파싱: 복잡한 도표, 표, 이미지 등을 .md 형식으로 변환.

- 의미 기반 청킹(Semantic Chunking): 표면적 문단 구분이 아닌 의미 단위로 문서 분할.

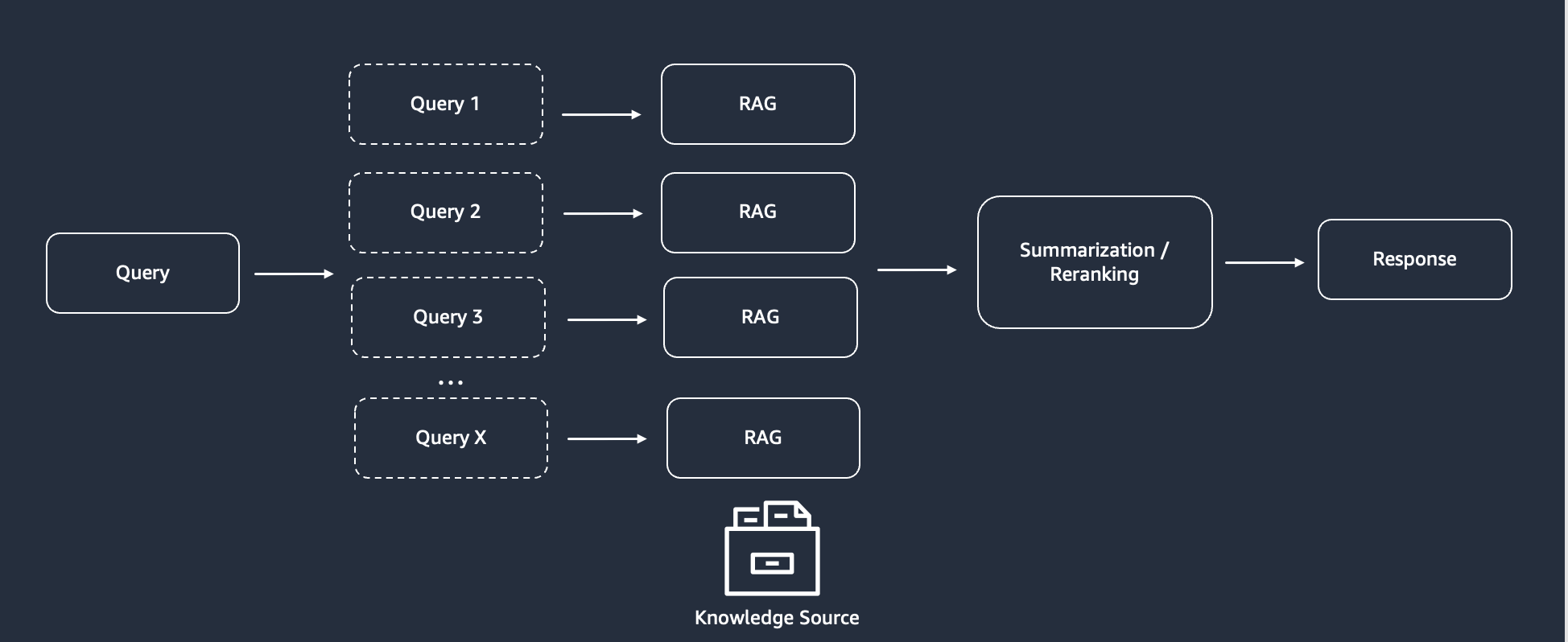

- 복합 질문 분해(Query Reformulation): 하나의 복잡한 질문을 소질문으로 분리 후 각각 검색.

- 다중 질의 방식(Multi-query RAG): 하나의 주제를 다양한 표현으로 질의하고 결과를 종합.

- 결과 재정렬(Reranking): 검색된 결과를 문맥과 의미 기반으로 FM을 통해 스코어링 후 재정렬.

여기서 가장 핵심은 Amazon Bedrock이 제공하는 명령형 청킹과 LLM 기반 리랭커 기능입니다. 이 기능은 각 문단 또는 문서 조각(chunk)의 의미 유사도 및 문맥 상 연관성을 분석하여, 높은 정확도의 응답 생성을 돕습니다.

RAG 평가 및 지속 자동화 전략

Nippon은 정확성, 완성도, 환각 여부 등 다각도의 평가 지표를 도입하여 응답 품질을 지속 검증하고 있습니다. 특히, 다음과 같은 항목을 통해 검증 지표를 확보했습니다:

- 정확도: 95% 이상 향상

- 환각 감소 수준: 90~95% 감소

- 보고서 생성 시간: 2일에서 10분으로 단축

- 출처 링크 삽입: 응답에 원문 링크 포함으로 신뢰도 향상

향후에는 GraphRAG(그래프 기반 응답 구조화), 메타데이터 필터링(최근 날짜 우선), Amazon Bedrock Agents(에이전트 기반 프로세스 자동화)를 통해 더욱 지속 가능한 자동화 인프라를 구축할 예정입니다.

결론

기업에서는 생성형 AI 도입 시 정확도와 활용도를 동시에 고려해야 합니다. Nippon 사례처럼 Amazon Bedrock Knowledge Bases와 고급 RAG 기법을 활용할 경우, 복잡한 문서 환경에서도 정확한 정보를 기반으로 한 자동화가 가능합니다. 특히, 다양한 청킹 전략과 리랭킹 방법, 멀티쿼리 전략 등을 결합하면 환각을 줄이고 신뢰도 높은 응답을 자동화할 수 있습니다.

이러한 RAG 방식은 Nippon에만 해당하는 것이 아니라, 의료, 법률, 제조 등 다양한 산업에서의 생성형 AI 도입에 적용할 수 있습니다. 이제 AI 어시스턴트를 단순 검색 도구가 아닌, 신뢰할 수 있는 업무 파트너로 발전시킬 수 있는 기반이 마련되었습니다.

AI, Cloud 관련한 문의는 아래 연락처로 연락주세요!

(주)에이클라우드

이메일 : acloud@a-cloud.co.kr

회사 번호 : 02-538-3988

회사 홈페이지 : https://www.a-cloud.co.kr/

문의하기