Amazon Q Developer와 MCP 서버를 활용한 딥러닝 환경 자동화 및 최적화 가이드

AI 및 머신러닝(ML) 기술이 진화함에 따라 기업들은 갈수록 복잡해지는 모델과 환경을 효율적으로 관리할 수 있는 인프라 구축에 직면하고 있습니다. 특히 AWS에서 제공하는 Deep Learning Containers(DLC)는 PyTorch, TensorFlow 기반의 모델을 컨테이너 환경에서 효율적으로 학습 및 추론하기 위한 강력한 도구입니다. 그러나 DLC를 프로젝트에 맞게 커스터마이징하는 과정은 여전히 많은 리소스를 요구하며 반복적인 작업이 발생합니다.

이러한 문제를 해결하기 위해 Amazon Web Services는 Amazon Q Developer와 Model Context Protocol(MCP) 서버를 통해 컨테이너 기반 AI/ML 워크플로우의 자동화 및 최적화를 지원하고 있습니다. 본 글에서는 Amazon Q와 DLC MCP 서버의 주요 기능, 활용 사례, 배포 가이드 등 실무자와 개발자를 위한 핵심 내용을 살펴보며, AI 개발환경의 혁신적인 접근 방식을 공유합니다.

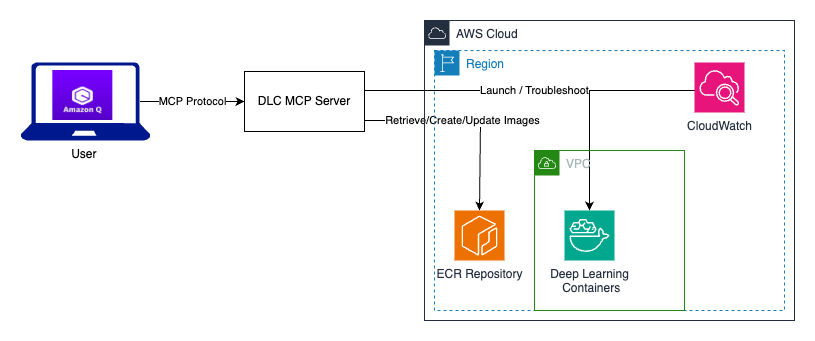

Amazon Q Developer와 DLC MCP 구조 이해

Amazon Q Developer는 자연어 기반 AWS 지식 기반 AI 도우미로, AWS 관련 아키텍처 설계와 리소스 관리, 모범 사례 적용을 대화형 방식으로 지원합니다. MCP는 이러한 Amazon Q가 외부 도구 및 서비스와 상호작용할 수 있게 하는 오픈 표준입니다.

Amazon Q Developer CLI에 MCP 서버를 연동하면 복잡한 컨테이너 환경 설정, 이미지 커스터마이징, 배포, 트러블슈팅 등을 자연어 명령으로 자동화할 수 있습니다.

DLC MCP 서버는 아래와 같은 6가지 서비스 기능을 통해 전체 개발 주기를 지원합니다.

- 컨테이너 관리: DLC 이미지 검색, 실행, AWS 인증, 분산 트레이닝 설정

- 이미지 빌드: 커스텀 Dockerfile 생성, ECR 푸시, 패키지 설치

- 배포: EC2, ECS, EKS, SageMaker 전송 지원

- 업그레이드: 딥러닝 프레임워크 최신화 및 호환성 검증

- 문제 해결: 로그 진단, 성능 최적화 가이드

- 베스트 프랙티스: 보안, 비용절감, 아키텍처 권고

활용 사례

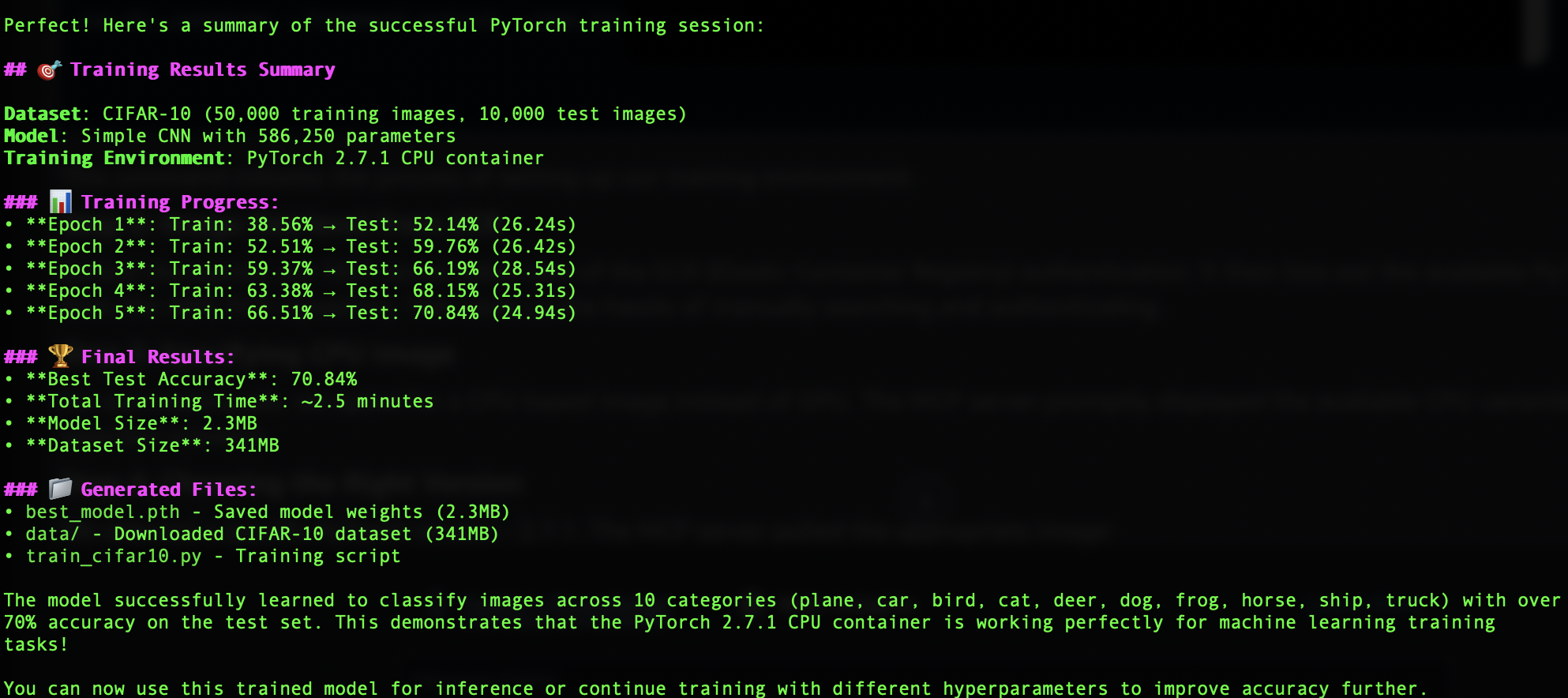

- DLC 트레이닝 컨테이너 실행

사용자는 "PyTorch 컨테이너 실행"이라는 자연어 프롬프트를 입력함으로써, MCP 서버를 통해 PyTorch 기반 DLC를 검색하고, ECR에서 이미지를 가져와 로컬에서 실행할 수 있습니다. 이후 테스트 스크립트를 통해 실행 여부를 확인하고 CIFAR-10 데이터셋을 활용한 실습도 자동화됩니다.

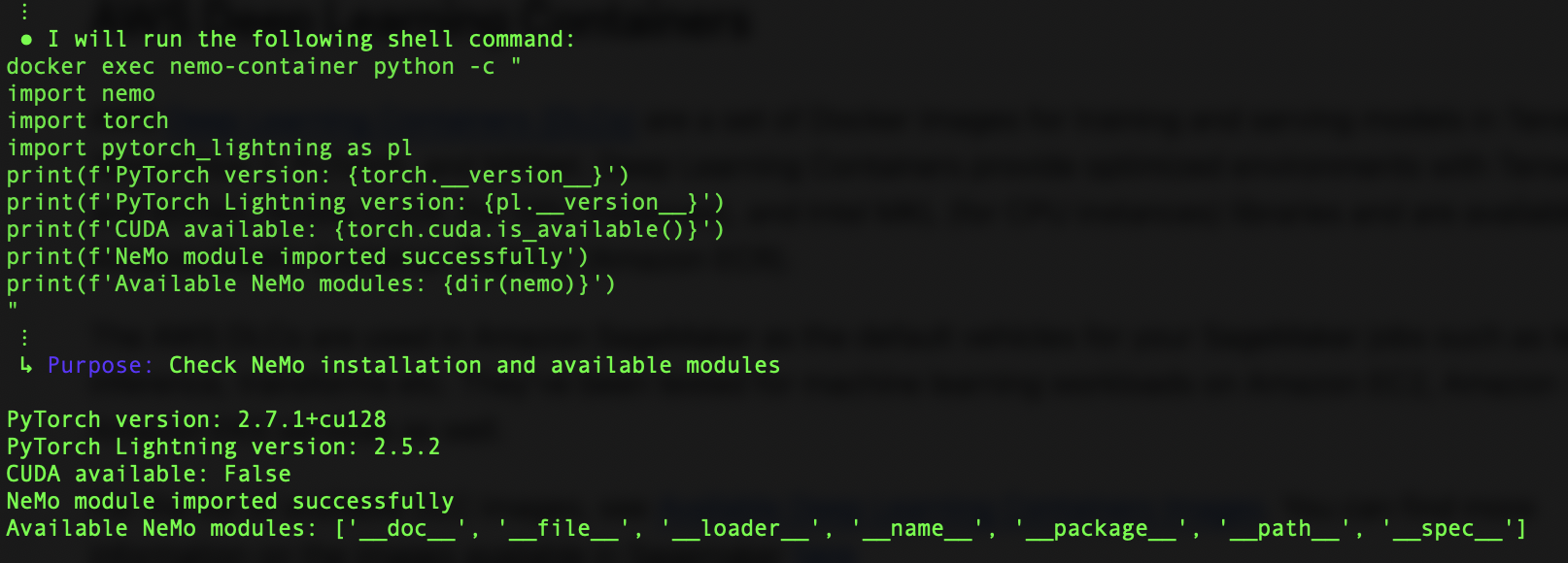

- NeMo 툴킷 통합 커스텀 DLC 생성

NVIDIA의 NeMo 툴킷은 대화형 AI에 최적화된 PyTorch 기반 프레임워크로, 이를 DLC에 통합하려면 복잡한 Dockerfile 작성 및 패키지 관리를 수행해야 합니다. Amazon Q는 NeMo 통합에 필요한 커맨드를 Dockerfile에 추가하고 이미지를 자동 빌드하여 ECR에 푸시합니다.

- DeepSeek 모델 통합 DLC

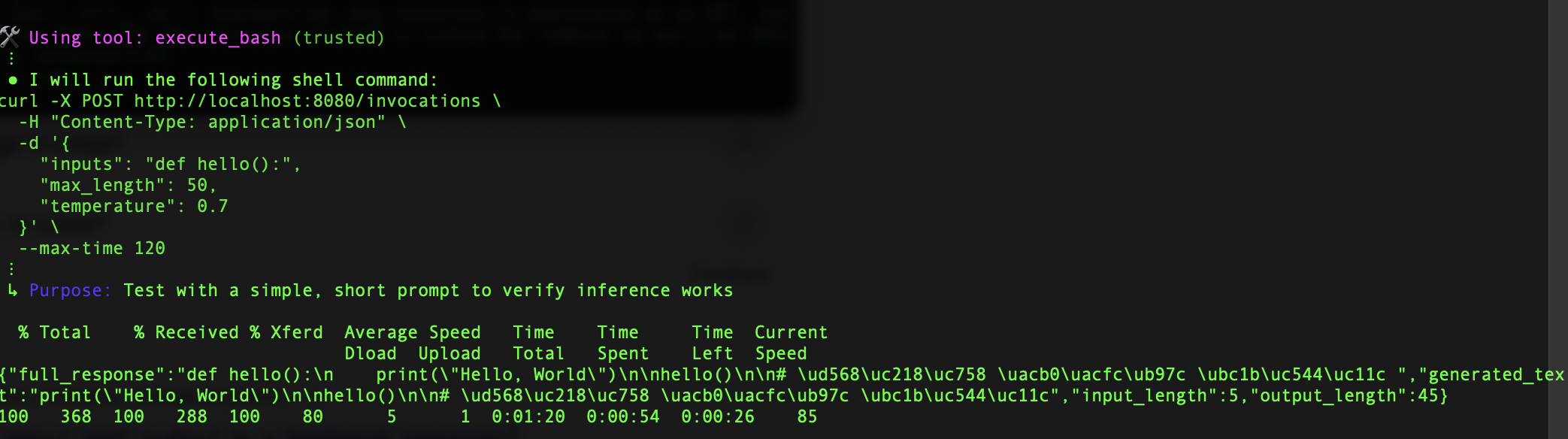

최신 PyTorch DLC GPU 기반 이미지에 DeepSeek 6.7B 언어 모델을 통합하는 시나리오에서는, Amazon Q가 적절한 기반 이미지를 추천한 뒤 build_custom_dlc_image 및 관련 스크립트를 자동 실행하며 완성된 Docker 이미지를 빌드합니다. 이후 간단한 헬스체크 및 Inference 테스트를 통해 정상 작동 여부를 확인할 수 있습니다.

배포 및 운영 자동화

MCP 서버는 생성된 이미지를 다양한 AWS 컴퓨팅 서비스 (EC2, EKS, ECS, SageMaker)에 손쉽게 배포할 수 있습니다. 자동화된 인프라 구성, 배포 상태 모니터링, 업그레이드 전략 수립 등도 포함되어 AI 팀의 지속 운영 효율성을 높입니다.

비교 및 이점 정리

기존의 수동 방법과 MCP 기반 자동화 방식의 차이를 비교해보면 다음과 같습니다.

| 항목 | 기존 수동 방식 | Amazon Q + MCP 방식 |

|---|---|---|

| Dockerfile 작성 | 수작업, 오류 잦음 | 자동 생성 |

| 패키지 설치 | 명령어 기반 설치 | 자연어 지시 가능 |

| 테스트 및 디버깅 | 반복 시간 소모 | 자동 테스트 도구 제공 |

| 다양한 환경 대응 | 환경별 반복 구성 | 범용 도커 이미지 자동화 |

| 배포 | 수동 클러스터 설정 | 멀티 서비스 자동화 배포 |

결론

Amazon Q Developer와 DLC MCP 서버는 AI 개발팀이 직면한 반복적인 환경 구성 문제를 자동화함으로써 개발자와 운영자의 부담을 획기적으로 줄이고 있습니다. 특히 딥러닝 모델을 운영 환경에 빠르고 안정적으로 적용할 수 있어 총 소유 비용(TCO) 절감 효과도 기대할 수 있습니다.

자연어 기반 워크플로우 관리가 가능한 새로운 접근 방식은, 이제 더 이상 미래 기술이 아닌 현재의 실질적인 솔루션입니다. 이 도구들과 함께라면 복잡한 인프라 문제는 여러분의 대화형 명령 한 줄로 해결됩니다.

AI, Cloud 관련한 문의는 아래 연락처로 연락주세요!

(주)에이클라우드

이메일 : acloud@a-cloud.co.kr

회사 번호 : 02-538-3988

회사 홈페이지 : https://www.a-cloud.co.kr/

문의하기